近期,合肥大学人工智能与大数据学院大模型与自然语言处理团队在大规模图学习与图神经网络轻量化方向取得重要进展。相关研究成果被国际权威期刊《IEEE Transactions on Neural Networks and Learning Systems》(TNNLS)正式录用。该论文由嵇圣硙副教授担任第一作者,2022级硕士生田育杰为主要学生作者,李新路教授担任通讯作者,合肥大学人工智能与大数据学院为第一完成单位。

研究背景:子图采样中的显存效率与精度损失权衡

图卷积神经网络(GCN)在社交网络、推荐系统等任务中具有广泛应用价值,但更深的聚合层和更大的图规模往往意味着更高的训练成本。为应对显存压力,研究者提出了节点级采样、层级采样和子图采样等多种轻量化训练策略,其中子图采样因能够保证所有节点被覆盖,成为大规模图学习中的重要路线。

然而,子图采样的核心代价在于:模型每次只能在局部子图上聚合信息,原本存在于全局图中的远距离连接关系和跨社区语义线索会被弱化,目标节点的感受野也因此受到限制。论文通过分析指出,这种“子图间隙”正是轻量化 GCN 精度受损的重要原因。

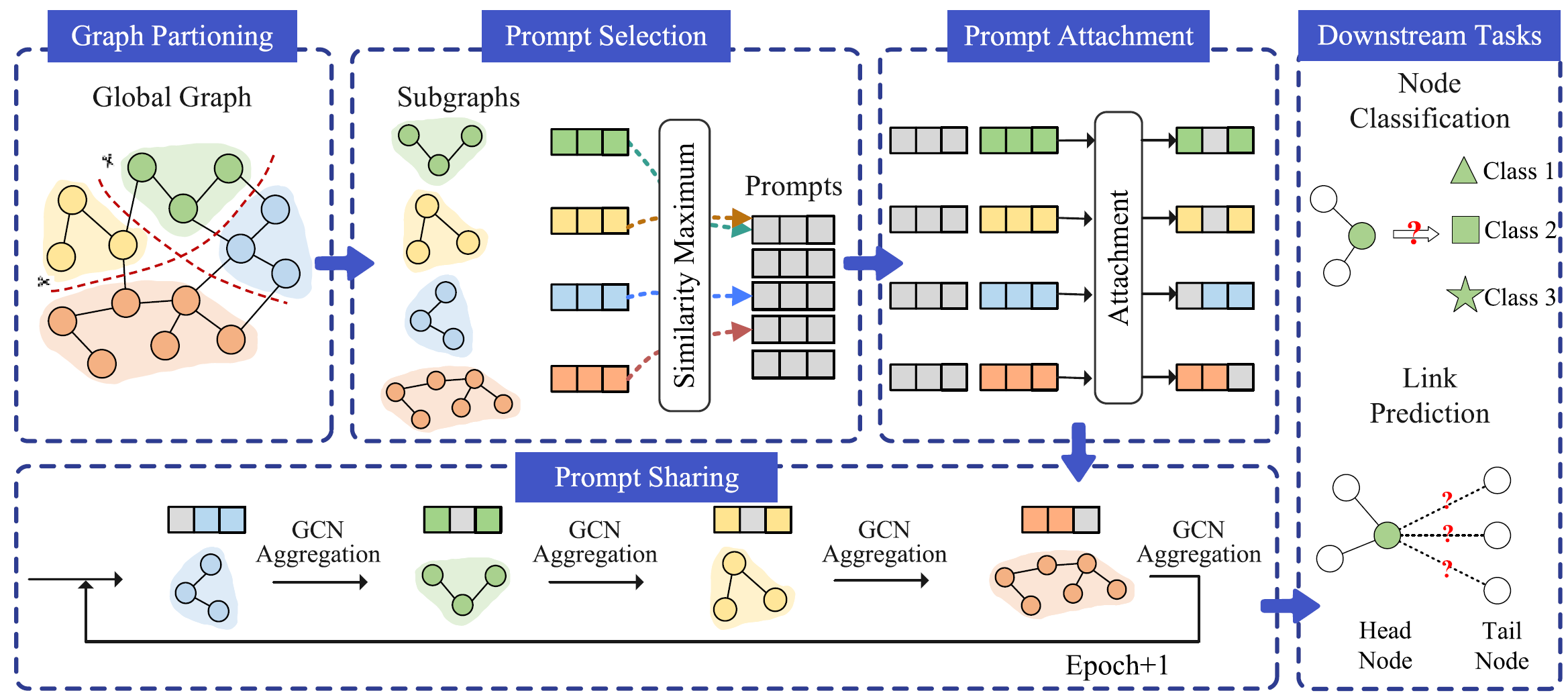

图注:PromptGCN 的整体流程包括图划分、提示选择、提示附加、提示共享以及下游任务建模;其中,共享提示在多个子图之间传递全局信息,从而缓解子图采样带来的信息割裂。

创新成果:提出可跨子图共享的轻量 GCN 框架

为解决上述挑战,论文首次将自然语言处理中常见的提示学习思路引入大规模图的子图采样训练,提出了一种轻量级提示式图卷积网络框架 PromptGCN。该方法并不直接扩大子图规模,也不额外引入大量外部节点,而是通过少量可学习的提示向量,在不同子图之间建立全局信息传递通道。

PromptGCN 的核心设计可以概括为三个环节:

1. 共享提示向量机制:构造一组可学习的提示向量作为全局信息载体,在保持低显存开销的同时,为局部子图补充跨子图语义。

2. 自适应提示选择与附加:每个节点根据与不同提示之间的相似度,动态选择最相关的提示向量,并通过拼接等方式将其附加到节点特征中,使局部表示能够感知更广范围的图结构信息。

3. 跨子图提示共享训练:在子图按顺序训练的过程中,共享提示随训练持续更新并在不同子图之间传递,使模型逐步积累全局图知识,从而近似获得全图训练带来的优势。

实验成效与学术价值

实验部分,论文在 5 个节点分类数据集和 2 个链路预测数据集上对 PromptGCN 进行了系统评估,覆盖 AmazonCoBuyPhoto、AmazonCoBuyComputer、Flickr、Reddit、Ogbn-products、Ogbl-citation2 和 Ogbl-collab 等典型大规模图任务。结果表明,PromptGCN 在多种骨干模型与下游任务上都表现出较强的适配能力,整体性能接近全批训练模型。

具体来看,在节点分类任务中,PromptGCN 相较于子图采样骨干方法在 Flickr 数据集上最高可带来 5.48% 的性能提升;在链路预测任务中,在 Ogbl-collab 数据集上可取得 2.02% 的提升。与此同时,该方法仍然保持了显著的内存效率:与全批训练 GCN 相比,随着层数加深,显存占用最多可降低约 8 倍;在大规模 Ogbn-products 数据集上,显存开销最高可降低约 28 倍。

论文还指出,PromptGCN 可以方便地与现有子图采样方法集成,既保持“轻量化”的工程优势,又有效提升模型精度。这意味着,在显存受限的真实部署环境中,研究人员有望以更低成本训练更深层、更大规模的图神经网络。

结语与展望

从研究意义上看,PromptGCN 重新审视了“轻量化图学习”与“全局信息建模”之间的关系,为大规模图神经网络训练提供了一条兼顾精度与效率的新路径。相比单纯依赖更大批量、更多邻居或更复杂图扩展机制的方案,这种基于共享提示的设计思路更为灵活,也更容易迁移到不同的子图采样框架中。

未来,围绕提示设计、提示数量自适应以及与更复杂图神经网络骨干的结合,PromptGCN 仍有进一步拓展空间。对于需要在有限算力条件下处理海量图数据的推荐、社交计算与知识图谱等场景而言,这项工作提供了具有启发性的技术路线。

论文题目:PromptGCN: Bridging Subgraph Gaps in Lightweight GCNs

代码链接:https://ieeexplore.ieee.org/document/11365573

(人工智能与大数据学院 撰稿:田育杰 初审:嵇圣硙 复审:吴志泽 终审:胡萍)